2012年9月,Kaggle举办了Merck分子活动数据挖掘大赛,各路分子生物学、医学、化学和药学,数据科学团队纷纷出场,展开激烈厮杀。

Geoffrey Hinton的博士团队拎着深度学习登场,两个星期就把各路高手挑下马,夺得冠军,有趣是该团队都是计算机和深度学习专家,丝毫没有生物、医学、分子和化学背景。

在很多人的印象中,深度学习人工智能应用的参与者应该只有两类,一类是行业专业人士,一类是搞计算机的。在深度学习面前资深专业人士完败,这一事件令许多外人为之震惊。

深度学习像互联网创新一样也在进行跨界的创新,而我认为人工智能比互联网带来的跨界冲击还厉害。

有人说,以前的许多技术出现之后人们能想到其应用场景发展空间,人工智能的出现跟以前大不相同,它的影响范围似乎没有明显的边界,使得各行业的专业人士都面临着受到冲击的危机。

对此,笔者认可的一种态度是:先学习一些人工智能的技术吧。

软硬件技术的发展和数据量的增长是如今人工智能得意再度兴起的关键,对普通人来说,从零开始面临重重挑战,从硬件系统开始,到软件系统,再到人工智能框架最后到应用的使用,关卡太多,任何一个环节都是挑战。

笔者作为业余的技术爱好者,曾尝试过在个人PC上搭建一个TensorFlow框架,虽然其安装的方式多种多样,但是由于版本更新迭代快,软件版本依赖太多,以至于这一过程进行的非常麻烦,最后成功搭建的环境还只是机遇CPU的版本,另外机遇GPU的版本会更为复杂。

我相信部分对人工智能好奇的人,可能会因为在这里受挫而放弃进一步探索的可能。

如果有一种平台型的工具能够帮你解决环境搭建的问题,可以让你把主要精力放在机器学习基础数据集的管理和模型的打造两方面,你觉得会怎样呢?

在NVIDIA中国深度学习学院(DLI)技术专家的指导下,笔者作为机器学习的门外汉,用DIGITS体验了一把用0代码做机器学习应用,省去了繁琐的搭建环境调试环境的过程,在DIGITS的帮助下你可以真正了解人工智能的最关键的部分。

开始动手进入深度神经网络的世界吧

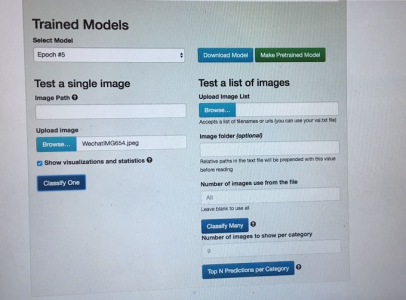

这次成功的体验做的是识别图片上数字的深度学习神经网络模型,更完整的叫法是Image Classifiaction with DIGITS,用DIGITS做图像分类/识别。

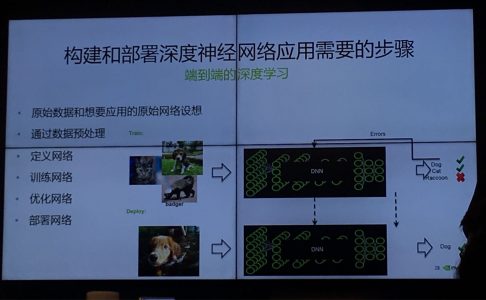

专家将其归纳为上图的六个步骤,为方便记忆,笔者将过程总结为四步:

第一步是创建数据集,是一个十几万张图片组成的数据集,并且要做一些数据处理;第二步是定义配置深度学习网络(DNN)模型;第三步可以观察DNN的训练过程,训练结果(比如精度、准确度),训练时间越长,数据集越大,模型越准;第四步以可视化的方式展示深度学习网络处理结果。

从讲解到分步完成,整个过程仅仅耗时二十多分钟。其中,比较耗时的是数据集的图片处理和训练过程两步,需要一些等待时间。

为验证模型的准确性,笔者上传了一张自己画的图片,为了增加难度所以画的尽可能丑一点。

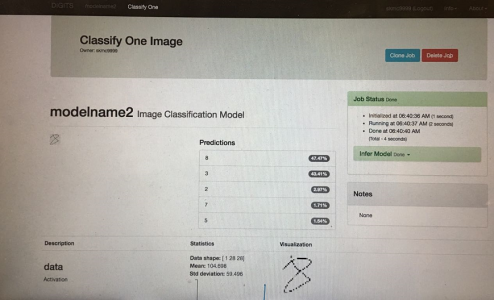

笔者自己的结果如下:47%的可能是数字8。图一张图片,另外一位模型下的测试的结果显示:99%的可能是8。这是因为模型的不同导致的,看来笔者的模型有很大的调优空间。

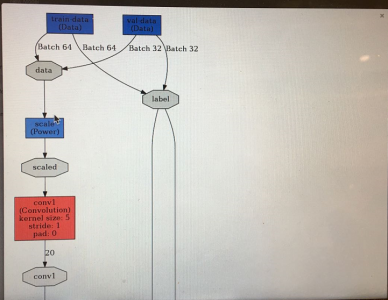

DNN模型的部分拓扑图,可以按照拓扑图修改代码和模型参数。

过程中,最大的好处是不用面对命令行,不用敲命令,只需点击操作配置即可,不用敲一行代码。

体验心得

通过几十分钟的操作,笔者对高深莫测的深度学习有了更清楚的认识。

想体验深度学习的朋友可以试试DIGITS,DIGITS是NVIDIA 深度学习学院 (DLI)的一个应用, NVIDIA 深度学习学院 (DLI)面向的人群是开发者、数据科学家和研究人员,可以为他们提供动手实验培训,培训的方式有在线自学式实验室,还有讲师指导式研讨会。

DIGITS最新6.0版本增加了TensorFlow框架的支持,开源框架支持的比较丰富,另外,在实验室平台上还可以体验到 NVIDIA 最新的 GPU 加速深度学习平台。

DIGITS有在线版本也有支持私有化部署的版本,在GitHub上可以下载到,所以说,本身DIGITS是免费的,但是如果是在线版的DIGITS的话因为是要占用云资源,尤其是昂贵的GPU资源,所以是要收费的,公网上可以找到DIGITS在线体验的链接。

NVIDIA做这个的目的也是在于便于不了解深度学习的人了解深度学习,让了解深度学习的人,更好的管理和处理数据集,把更多精力放在模型打造和模型训练调优上。在这个学习平台想学知识的人可以获取知识,比较厉害的人还可以考虑当DLI的讲师。

除了NVIDIA的这个人工智能学习平台以外,许多公有云服务商也都有类似的深度学习服务平台,比如AWS、Google、Azure等公有云,看来在线的深度平台已经是业内非常认可的服务方式。(DOIT/朱朋博)