随着AI在产业中的普及应用,各类型场景对人工智能算力的需求不断被释放,提供训练、推理能力的AI芯片产品百花齐放。而芯片算力的有效利用,需要与成熟的深度学习框架适配协同。

近日,人工智能计算领域的引领者NVIDIA召开了全球开发者大会GTC 2023,GPU芯片与百度飞桨深度学习平台的合作持续深入,百度技术专家特别分享了飞桨如何支持大模型生产和应用、大规模图学习训练技术PGLBox、端到端大模型开发套件PaddleFleetX、全场景高性能AI部署工具FastDeploy等前沿内容。

深度学习框架是连接软硬件的关键软件平台,框架与AI芯片、计算系统的联合优化是充分释放算力、实现AI基础设施极致优化的重点。飞桨作为中国首个自主研发、开源开放的产业级深度学习平台,已发展成为中国市场应用规模第一的深度学习框架和赋能平台,技术和生态实力深受广大硬件厂商认可,合作日趋紧密,由此也为开发者提供了软硬一体的便捷体验。

硬件厂商与飞桨的合作经历了“共聚”“共研”“共创”三个阶段,且逐年深入。基于AI基础软硬件协同发展趋势的判断,飞桨于2020年,率先与国内外领先的硬件厂商开展对接,获得积极响应和支持。2021年,飞桨与硬件伙伴携手共研解决适配技术方案复杂、成本高等问题,飞桨推出了多层次、低成本的硬件适配统一方案,包括自定义算子库接入、自定义通信库等多项基础软件改造,硬件伙伴可以根据硬件特性灵活选择,极大降低适配成本。截至目前,超过40家硬件厂商与飞桨深度融合优化,基本全适配国产芯片。

2022年,飞桨与硬件伙伴从适配优化进一步发展到协同创新的“共创”阶段。硬件伙伴希望通过定制版的飞桨框架、模型库等来丰富其自身的AI软件栈。飞桨也能通过硬件底层开发体验的提升,帮助更多开发者低门槛实现AI应用创新。

NVIDIA与飞桨率先完成了联创工作。以NVIDIA合作为范例,飞桨与国内外更多硬件伙伴联合发布了基于飞桨开源版的厂商定制版飞桨框架和模型库等。

据介绍,NVIDIA将飞桨列为全球前三的深度学习框架合作伙伴,在中国设立了专门的工程团队支持,赋能飞桨。双方联合开发了三大主要产品:基于NVIDIA GPU定制优化的飞桨容器NGC,包含了最新的NVIDIA工具包(CUDA、DALI等)和优化的飞桨版本,为开发者提供最佳开发环境;NVIDIA Deep Learning Examples向用户提供易于训练和部署的飞桨模型示例;在NVIDIA深度学习培训中心(DLI)打造系列免费课程及联名认证证书,帮助开发者提高训推性能并简化代码,并给予权威认可。

百度AI技术生态总经理马艳军在GTC演讲中表示,人工智能应用的发展离不开硬件合作伙伴的共同努力。我们联合NVIDIA、Intel和Arm等13家合作伙伴共同发布了飞桨生态发行版,实现软硬件协同深度优化。飞桨“硬件生态共创计划”伙伴数量已达29家,聚生态之力,共同打造软硬一体的全栈式AI平台,促进人工智能产业链高质量发展。

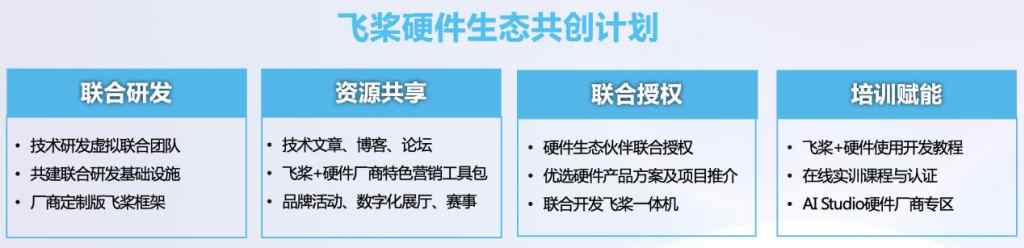

飞桨“硬件生态共创计划”主要包含联合研发、资源共享、联合授权、培训赋能四项重点工作,旨在协同战略合作伙伴软硬一体全面共创,以更好地服务开发者。

在联合研发方面,飞桨与硬件伙伴成立技术研发虚拟联合团队,共建联合研发基础设施,并对模型进行性能优化,推出厂商定制版飞桨框架,大大提升飞桨模型在各类AI硬件上的训练推理性能,为开发者提供更多更好选择。

在资源共享方面,飞桨与硬件伙伴共享推广宣传资源,合作打磨飞桨+硬件厂商特色营销工具包,并通过品牌活动、赛事、闭门会、数字化展厅等提供展示平台,帮助业务拓展。

在联合授权方面,飞桨会将与硬件伙伴联合优化的方案和飞桨的特色能力优先推荐给生态伙伴。飞桨还基于硬件平台联合开发飞桨一体机,为企业提供功能全面、便捷高效、稳定可靠的一站式人工智能服务。

在培训赋能方面,飞桨与硬件伙伴联合开发飞桨+硬件使用开发教程,并在双方的学习与实训社区提供系列课程及联名认证证书。其中,飞桨AI Studio已经是全国最大的人工智能学习与实训社区,拥有超过300万注册用户。飞桨AI Studio还开设了硬件厂商专区,为开发者提供体验更多AI硬件的机会。

随着人工智能技术在各行业的广泛应用,业界已从各自独立的硬件算力驱动和算法创新驱动进入到算法和硬件协同创新阶段。飞桨将通过硬件生态共创计划,结合伙伴自有软硬件基础开发栈特色,真正实现软硬件互联互通、创新发展。

飞桨秉持AI时代操作系统的产业链定位,开放拥抱所有硬件厂商。通过技术联合研发和生态共享共创,飞桨将携手硬件伙伴一起开拓更多软硬件协同的产品和服务,加速人工智能的应用落地,推动AI工业大生产实现进程。