谷歌 CEO 最新访谈的重点整理

谷歌母公司Alphabet CEO Sundar Pichai近日接受了《The Circuit With Emily Chang》节目访谈。

其观点和战略要点整理如下:

1. AI 尚处于早期阶段,不惧怕 OpenAI

自2016年以来,AI一直是Alphabet的重点。虽然错过了聊天机器人的早期机会,但皮查伊认为AI仍处于早期阶段。谷歌有时间在AI领域取得领先。

2. 谷歌推出了AI模型Gemini,能识别多种类型的信息。但初期生成错误历史图像,行业普遍存在类似问题。未来将分辨合成内容作为未来十年定义搜索的关键,并强调谷歌在验证信息真实性方面的优势。

3. 自认是合格的领导者,已经转向AI,增加对YouTube和云计算的投资。

3. “20% 时间”的文化是否是一种特权?

谷歌倡导员工将20%时间用于个人项目。这种文化激发创新,保留活力、开放、鼓励辩论的文化至关重要。

4. 谷歌没必要分拆。在多市场占据主导地位,引发监管关注。未来将整合策略推动创新,增加市场选择,无需分拆。

5. 科技公司纷纷推出AI驱动的硬件产品。智能手机将是AI创新的核心平台,未来会包括智能眼镜等可穿戴设备。

HBM3E 订单争夺战继续,三大内存企业瞄准博通需求

博通计划在基于谷歌TPU芯片的AI服务器中采用HBM3E内存。目前三星电子、SK 海力士、美光已向博通提供8层堆叠的HBM3E内存早期样品。博通在其交换机芯片和定制ASIC设计中对高带宽低延迟内存的需求,推动了对HBM内存的依赖。 未来随着AI服务器对高性能计算的需求增加,博通的HBM3E订单将显著影响未来市场格局。

博通去年实现了 299.5 亿美元的半导体相关收入,在无厂设计企业中排到第三,仅次于英伟达和高通。从 2019 年以来,博通一直在部分交换机芯片中使用 HBM 内存作为数据缓冲,因为传统的封装外 DRAM 难以满足交换机芯片对高带宽低延迟的需求。而在 ASIC 设计业务部分,博通为谷歌、Meta 等企业设计定制芯片,最为代表性的产品就是谷歌的 TPU 系列。

韩媒 ZDNet Korea 报道,继争夺英伟达及 AMD 的 AI GPU / 加速器用 HBM3E 内存合同后,三星电子、SK 海力士、美光不约而同地盯上了芯片设计大厂博通的 HBM3E 订单。

博通去年实现了 299.5 亿美元的半导体相关收入,在无厂设计企业中排到第三,仅次于英伟达和高通。

消息称SK 海力士系统集成电路拟向中企转让无锡晶圆厂49.9%股权

5月9日消息,据韩联社报道,SK 海力士子公司 SK 海力士系统集成电路拟向无锡产业发展集团有限公司转让所持有的 SK 海力士系统集成电路(无锡)有限公司49.9%股权。

SK 海力士系统集成电路于2018 年从母公司独立,主要从事8英寸晶圆成熟制程代工业务,产品覆盖车用 PMIC、电视 DDI 等类别。无锡产业发展集团有限公司是由无锡市人民政府成立的地方国企集团,2023 年该集团营业收入约 789.81 亿元人民币。

本次股权转让计划分为两个步骤,首阶段 SK 海力士系统集成电路将以 2054 亿韩元(当前约 10.87 亿元人民币)的价格向无锡产业发展集团出售无锡晶圆厂 21.33% 的股份;

此后无锡产业发展集团再以参与有偿增资的方式追加取得无锡晶圆厂 28.6% 的股份。

完成交易后,SK 海力士系统集成电路和无锡产业发展集团将分别持有该晶圆厂 50.1% 和 49.9% 的股份,SK 海力士系统集成电路仍将是无锡晶圆厂的实际控制人。

同时 SK 海力士系统集成电路还将以 1209 亿韩元(当前约 6.4 亿元人民币)向无锡产业发展集团转让工艺技术等无形资产。

韩媒认为,SK 海力士系统集成电路此举是为了加强无锡晶圆厂同中国市场的联系,扩大在中业务。

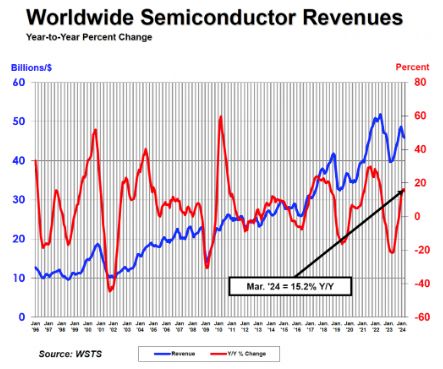

SIA 机构称24Q1 全球半导体收入 1377 亿美元,同比增长 15.2%、环比下降5.7%

半导体行业协会(SIA)公布的最新数据显示,2024 年第 1 季度全球半导体收入为 1377 亿美元(当前约 9941.94 亿元人民币),同比增长 15.2%,环比下降 5.7%。

SIA 认为同比涨幅高于去年同期,而环比下降的主要原因是季节性原因。SIA 预估2024 年第 2-4 季度的同比涨幅将达到两位数。

SIA 并未透露具体哪些市场领域贡献了多少,不过半导体市场整体复苏可能有两方面的原因,其一是存储芯片市场的复苏,另一个是人工智能数据中心芯片销售扩大。

按地区划分,中国收入同比增长 27.4%,北美收入同比增长 26.3%。亚太地区同期增长 11.1%;欧洲和日本分别收缩6.8% 和 9.3%。

英伟达收购两家AI创企,要让 AI 芯片变得更便宜!

英伟达正成为 AI 热潮中最活跃的企业投资方之一,在去年投资 30 多家创企后,现在它的投资名单又新增两家以色列 AI 创企 ——Run:ai 与 Deci。

其中Run:ai能提高 AI 芯片效率,实现高效集群资源利用。Run:ai 成立于 2018 年,是一个基于 kubernetes 的工作负载管理和编排软件提供商,旨在实现高效 GPU 集群资源利用。

它支持开发人员并行运行多个 AI 工作负载,而不是按顺序运行,从而提高 AI 芯片的效率,这反过来又有助于减少完成任务所需的英伟达 GPU 数量。

收购 Run:ai 是英伟达自 2019 年 3 月以 69 亿美元收购 Mellanox 以来在以色列的最大收购交易。

Deci自研更小的模型,开源领域对阵 Llama、Mistral。Deci成立于 2019 年的 Deci,侧重点则不同,通过调整 AI 模型使其可以在 AI 芯片上更便宜地运行,并为使用英伟达 CUDA 软件开发的机器学习应用提供动力 —— 例如通过使模型变小。

根据其网站,Deci 为包括 Adobe、应用材料在内的客户提供服务。其方法与另一家初创公司英伟达去年悄悄收购的 OmniML 相似,OmniML 旨在缩小机器学习模型。

这家创企最初协助在手机、汽车等端侧设备上启用相对简单的 AI 应用,随后转向自研大模型,在开源领域展开竞争。其自研模型已上传至其网站及 Hugging Face 社区。微软也是 Deci 的合作伙伴,通过微软 Azure AI Studio 可访问 Deci 的技术。

去年 12 月,Deci 的模型 DeciLM 在 Hugging Face 包含 70 亿参数的模型排名中名列第一,在开源领域超过 Llama、Mistral 等对手。但在 2 月底谷歌推出全新 Gemma 模型后,Deci 失去领先地位。

据 The Information 报道,两位了解交易情况的人称,Run:ai 提高 AI 芯片效率的能力可能会吸引更多客户使用 NVIDIA DGX Cloud。英伟达可能会提供 Deci 和 OmniML 技术以及 CUDA 软件,以使开发人员构建 AI 驱动的应用程序更便宜。