5月15日,2024春季火山引擎 FORCE 原动力大会泛互联网专场圆满举办。小冰公司 CEO、前微软(亚洲)互联网工程院常务副院长李笛应邀参加,并在“AI 和云驱动下的互联网新十年”泛互联网分论坛进行分享。

李笛表示,AI 是最具浪漫主义色彩的人类技术,经过数年的商业模式创新,已经进化成为高附加值生产力,它不仅是单一工具,更能够产生智慧价值,以此获得更大的价值回报。企业需要快速实现创新的商业化落地,而不是等待技术的完美成熟。这种实用主义的方法有助于确保技术进步能够转化为实际的商业价值和社会影响。

数字人创新应用,树立AI创新应用标杆

小冰,源自微软(亚洲)互联网工程院的人工智能小冰团队,自2013年在中国成立以来,一直致力于 AI 技术的研发和应用。作为微软全球最大的人工智能独立产品研发团队,小冰不断突破技术边界,推出了一系列领先的人工智能+云计算商业化解决方案,包括“小冰克隆人、X Studio、数字员工”等。其中,“小冰克隆人”实现了数字人的高度个性化定制和智能化交互,为行业树立了新的标杆。

李笛说:“我们希望 AI 技术不仅能在快速增长中崭露头角,更能在历经时间的考验后,稳固地落地生根,沉淀成为企业赖以生存和发展的稳定核心竞争力。小冰致力于打造这样的产品,帮助他们取得成功。”

随着科技的迅猛发展,AI 技术愈发成为推动社会前行的关键力量,其应用场景不断拓展,潜力极为广阔。尽管 AI 技术应用前景广阔,但在实际落地过程中,小冰也遇到了诸多挑战。

小冰在推进 AI 技术商业化落地的过程中,需要解决许多技术难题。例如:进一步提高大模型训练中的GPU资源利用率、确保多机多卡训练顺利进行、谨防梯度爆炸发生等。此外,还有多部门共用资源可能带来的紧张问题。面对这些挑战,小冰选择与火山引擎合作,共同探索解决方案,打破发展瓶颈,推动 AI 产品和解决方案的创新应用。

训推加速方案、豆包大模型联动,破解多样化挑战

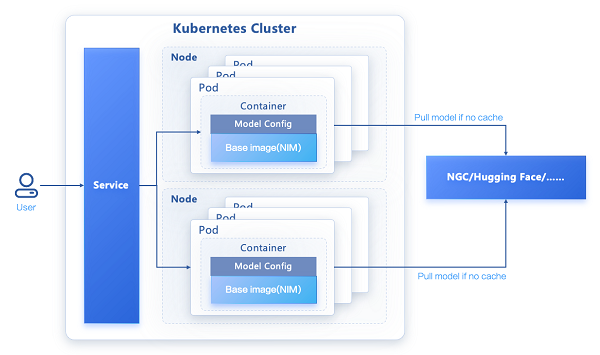

火山引擎大模型训练和推理加速解决方案,通过机器学习平台提供的全栈 AI 开发工程优化、任务故障自愈、实验可观测性以及解决方案和最佳实践,解决了小冰大模型训练中 GPU 资源利用率损耗等问题,极大提升了大模型训练的效率和稳定性,训练周期缩短了近一半。而通过火山引擎提供的多款 GPU 推理资源的组合方案,小冰实现了不同业务使用不同的推理资源,在解决了推理资源紧张的同时,也实现了极致性价比。

通过接入豆包大模型、豆包·声音复刻模型和内容增强插件,“小冰克隆人”丰富了全链路产品功能,优化了用户体验,还有效降低了业务成本。在极短时间内,“小冰克隆人”即可完成声音复刻,并高度还原真人音色特点,同时可以快速获取最新的热点新闻和知识技术,更好地与用户进行互动。

除技术层面的合作外,小冰和火山引擎还共同探索 AI 技术在更多领域内的应用,推出了一系列基于 AI 技术的商业化解决方案和产品服务,如 AI 客服、智能营销、虚拟主播等,满足企业客户的多样化需求,为行业带来更多的创新和发展机遇。

火山引擎作为字节跳动旗下的云服务平台,致力于为用户提供高效、可靠、安全且具有创新性的云服务解决方案。未来,小冰与火山引擎将展开更多深层次合作,火山引擎技术能力的演进将直接有益于小冰的业务场景,小冰也将提炼出更多典型场景并封装为标准化能力提供给更多企业使用,形成更多基于 AI 的具有高附加值的智能化产品。